A mesterséges intelligencia vállalati adaptációja új mérföldkőhöz érkezett. Míg a nagy nyelvi modellek (LLM-ek), mint a GPT-sorozat, lenyűgöző képességeket mutattak be, a vállalati környezetben való alkalmazásuk komoly kihívásokba ütközött. A pontatlan információk, az elavult tudás és az adatbiztonsági aggályok gátat szabtak a széleskörű elterjedésnek. Erre a problémára ad választ a Retrieval-Augmented Generation (RAG) technológia, amely egyre inkább az enterprise AI stratégiák sarokkövévé válik. Ezt a trendet erősíti a ServiceNow és az Anthropic nemrég bejelentett partnersége is, amelynek célja, hogy az Anthropic Claude modelljeit integrálják a ServiceNow platformjába, előtérbe helyezve a megbízható és biztonságos AI megoldásokat.

Ez a cikk mélyrehatóan elemzi, miért jelentenek a RAG AI chatbotok forradalmi áttörést a vállalatok számára. Bemutatjuk a technológia működését, üzleti előnyeit, és lépésről lépésre végigvezetjük az implementáció folyamatán, hogy Ön is kiaknázhassa a benne rejlő hatalmas potenciált.

Bevezetés: Az LLM-ek Korlátainak Túllépése az Enterprise AI-ban

A nagy nyelvi modellek (LLM-ek) berobbanása a köztudatba óriási ígéretet hozott a vállalati automatizálás és hatékonyságnövelés terén. Az ötlet, hogy egy intelligens asszisztens azonnal választ adhat komplex kérdésekre, dokumentumokat foglalhat össze, vagy akár kódot is írhat, sok vezető fantáziáját megmozgatta. Azonban a kezdeti lelkesedést hamar követték a kijózanító tapasztalatok.

A hagyományos LLM-ek, bár rendkívül sokoldalúak, egy alapvető korláttal rendelkeznek: tudásuk statikus. A tréningadatbázisuk egy adott időpontban lezárt, így nem ismerik a legfrissebb eseményeket, piaci változásokat vagy a vállalat belső, privát adatait. Ez több kritikus problémát is felvet:

- Hallucinációk: Amikor egy LLM nem rendelkezik a szükséges információval, hajlamos „kitalálni” a választ, ami súlyos üzleti hibákhoz és a bizalom elvesztéséhez vezethet.

- Elavult adatok: Egy olyan modell, amelynek tudása 2023-ban véget ér, nem adhat releváns tanácsot a 2026-os piaci trendekről vagy a legújabb belső szabályzatokról.

- Adatbiztonsági kockázatok: A nyilvános LLM-ek használata során a vállalatok érzékeny adatai külső szerverekre kerülhetnek, ami komoly adatvédelmi és megfelelőségi aggályokat vet fel.

A Probléma és a Megoldás

A Probléma: A standard LLM-ek pontatlanok, elavultak és nem biztonságosak a vállalati adatok számára. Nem férnek hozzá a belső tudásbázisokhoz, ami megbízhatatlanná teszi őket a kritikus üzleti feladatokban.

A Megoldás: A RAG (Retrieval-Augmented Generation) technológia, amely összekapcsolja az LLM-eket a vállalat saját, valós idejű adatforrásaival. Ez garantálja a pontosságot, a naprakészséget és az adatbiztonságot, lehetővé téve a megbízható vállalati AI asszisztensek létrehozását.

Ezekre a kihívásokra ad választ a RAG, amely nem lecseréli, hanem kiegészíti és feljavítja az LLM-eket. A RAG egyfajta „nyitott könyves vizsgát” tesz lehetővé a mesterséges intelligencia számára, ahol a válaszok generálása előtt releváns, ellenőrzött információkat keres a vállalat saját dokumentumaiból. Ez a paradigma-váltás teszi lehetővé, hogy az AI valóban megbízható és értékes eszközzé váljon a vállalati ökoszisztémában.

Mi az a RAG (Retrieval-Augmented Generation) AI Chatbot?

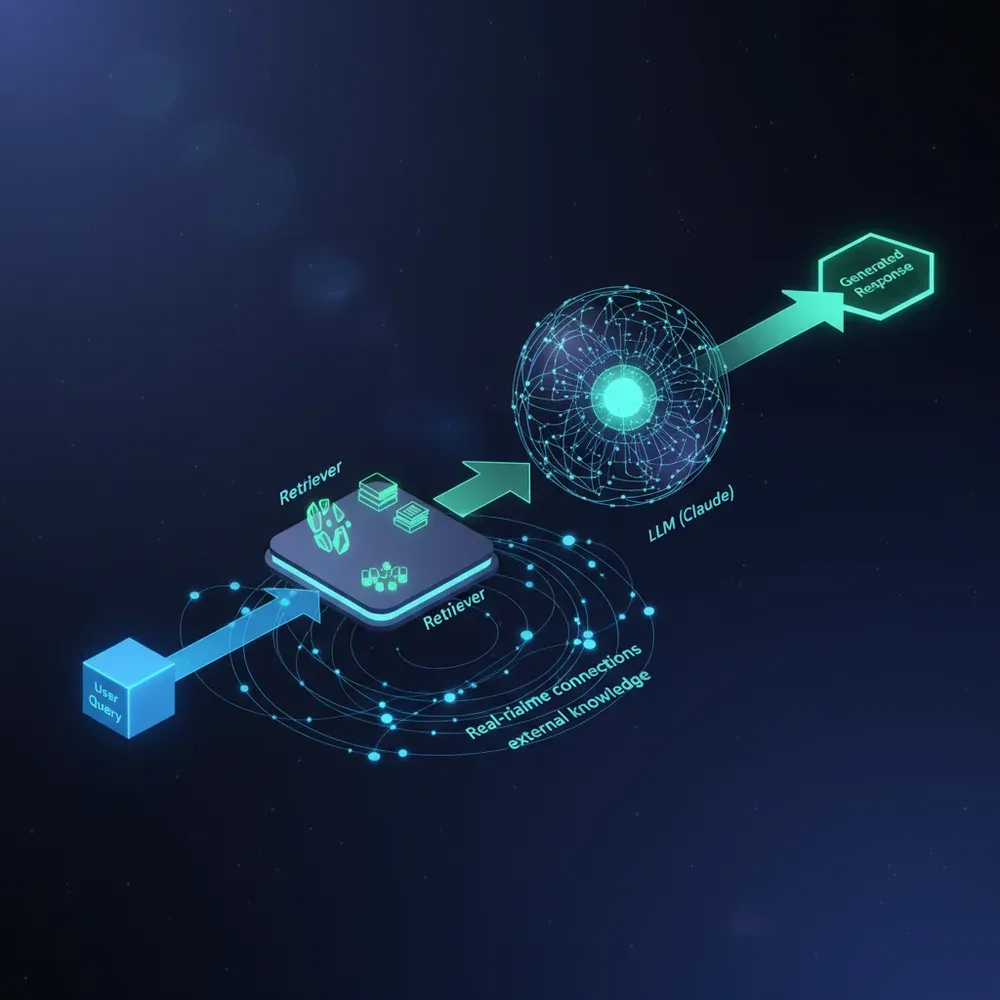

A Retrieval-Augmented Generation, vagyis RAG, egy olyan mesterséges intelligencia architektúra, amely a nagy nyelvi modellek (LLM) generatív képességeit egy külső tudásbázisból történő információ-visszakeresési (retrieval) mechanizmussal ötvözi. Egyszerűbben fogalmazva, a RAG chatbot nem csupán a betanított, általános tudására hagyatkozik, hanem minden egyes kérdés megválaszolása előtt „utánanéz” a releváns információknak a vállalat saját, megbízható adatforrásaiban.

Képzeljük el a különbséget egy olyan diák között, aki csak az emlékezetéből ír egy dolgozatot, és egy másik között, aki közben használhatja a könyvtárat, a jegyzeteit és a legfrissebb kutatási anyagokat. A RAG chatbot ez utóbbi diák: a válaszai megalapozottak, tényekkel alátámasztottak és mindig a legfrissebb, legrelevánsabb forrásokra épülnek.

A RAG rendszer két fő komponensből áll:

- A Visszakereső (Retriever): Ez a komponens felelős azért, hogy a felhasználói kérdés alapján megtalálja a leginkább releváns információmorzsákat a vállalat tudásbázisából. Ez a tudásbázis lehet bármi: PDF dokumentumok, Word fájlok, weboldalak, Confluence oldalak, adatbázis-rekordok vagy akár API-hívások eredményei. A visszakereső egy speciális, úgynevezett vektoradatbázist használ a villámgyors és kontextus-alapú kereséshez.

- A Generátor (Generator): Ez általában egy erőteljes LLM (mint például az Anthropic Claude vagy az OpenAI GPT-4). Miután a visszakereső összegyűjtötte a releváns információkat (a „kontextust”), átadja azokat a generátornak a felhasználói kérdéssel együtt. Az LLM feladata, hogy ezen kontextus alapján egy koherens, emberi nyelven megfogalmazott, pontos választ generáljon.

Definíció: RAG

A RAG (Retrieval-Augmented Generation) egy olyan AI-módszer, amely a nyelvi modellek válaszgenerálását egy külső, naprakész tudásbázisból származó, releváns információk dinamikus visszakeresésével egészíti ki. Ahelyett, hogy a modell csak a statikus tréningadataira támaszkodna, a RAG lehetővé teszi számára, hogy tényeket keressen és idézzen, így drasztikusan növelve a válaszok pontosságát és megbízhatóságát.

Ez a folyamat biztosítja, hogy a chatbot válaszai ne csak nyelvtanilag legyenek helyesek, hanem tartalmilag is pontosak és a vállalat specifikus tudásanyagán alapuljanak. A RAG így hidat képez az általános célú AI modellek és a specifikus vállalati igények között.

Miért Elengedhetetlen a RAG az Enterprise AI Stratégiához?

A RAG nem csupán egy technikai fejlesztés; ez egy stratégiai szükségszerűség minden vállalat számára, amely komolyan gondolja a mesterséges intelligencia bevezetését. Míg a kísérleti fázisban elegendő lehet egy általános chatbot, az éles üzleti környezetben a megbízhatóság, a biztonság és a pontosság nem alku tárgya. A RAG pontosan ezeket a kritikus vállalati igényeket elégíti ki.

Nézzük meg a legfontosabb okokat, amiért a RAG elengedhetetlen egy modern enterprise AI stratégiához:

- A Hallucinációk Minimalizálása: Ez talán a legfontosabb előny. Mivel a RAG modell a válaszait a visszakeresett, ellenőrzött vállalati dokumentumokra alapozza, drasztikusan csökken a valótlan információk generálásának esélye. A modell „le van horgonyozva” a tényekhez, ami elengedhetetlen a megbízható működéshez.

- Fokozott Adatbiztonság és Adatvédelem: A RAG architektúra lehetővé teszi, hogy a vállalat teljes mértékben kontrollálja az adatfolyamokat. A privát tudásbázis maradhat a cég saját infrastruktúráján (on-premise) vagy privát felhőjében, és csak a releváns információmorzsák kerülnek át az LLM-hez a válaszgenerálás idejére. Ezzel elkerülhető az érzékeny adatok kiszivárgása, és biztosítható a GDPR-megfelelés.

- Hozzáférés Valós Idejű és Saját Adatokhoz: A piac folyamatosan változik, a belső szabályzatok frissülnek. A RAG rendszerek képesek azonnal indexelni az új információkat, így a chatbot tudása mindig naprakész. Legyen szó a legújabb értékesítési adatokról, egy friss HR-irányelvről vagy egy új termék műszaki specifikációjáról, a chatbot azonnal hozzáfér.

- Javított Pontosság és Relevancia: A RAG chatbotok nem általános, hanem specifikus, kontextus-tudatos válaszokat adnak. Megértik a vállalati szakzsargont, ismerik a belső folyamatokat és a termékspecifikus részleteket, ami a felhasználói élményt és a hatékonyságot is növeli.

- Átláthatóság és Ellenőrizhetőség: Egy jól implementált RAG rendszer képes megjelölni a forrásokat, amelyeket a válasz generálásához felhasznált. Ez lehetővé teszi a felhasználók számára, hogy ellenőrizzék az információk helyességét, ami növeli a rendszer iránti bizalmat és kritikus fontosságú a szabályozott iparágakban (pl. pénzügy, egészségügy).

Ezek a képességek teszik a RAG-ot a megbízható vállalati AI alkalmazások alapkövévé. Ha szeretné megismerni, hogyan építhetünk az Ön vállalata számára is egy ilyen biztonságos és hatékony rendszert, ismerje meg intelligens ügyfélszolgálati AI chatbot szolgáltatásunkat.

A ServiceNow és Anthropic Partnersége: A Claude Modellek Ereje az Enterprise-ben

A vállalati AI piac érettségét jól mutatják az olyan stratégiai partnerségek, mint a ServiceNow és az Anthropic közötti együttműködés. Ez a szövetség nem csupán két technológiai óriás összefogása; ez egyértelmű jelzés arra, hogy a jövő vállalati AI megoldásai a megbízhatóságra, a biztonságra és a testreszabhatóságra épülnek – mindazokra az elvekre, amelyeket a RAG architektúra is képvisel.

A ServiceNow, a digitális munkafolyamatok piacvezető platformja, hatalmas mennyiségű strukturált és strukturálatlan vállalati adat fölött őrködik. Az Anthropic, amelyet a biztonság-központú AI fejlesztés iránti elkötelezettségéről ismerünk, a Claude modellcsaláddal egy rendkívül erős, mégis kontrollálható nyelvi modellt kínál. A partnerség lényege, hogy az Anthropic Claude modelljeit natívan integrálják a ServiceNow platformba, így a vállalatok közvetlenül a munkafolyamataikban aknázhatják ki a generatív AI erejét.

Ez a partnerség több szempontból is kiemeli a RAG fontosságát:

- Fókusz a Megbízható AI-n: Az Anthropic mindig is a „konstitucionális AI” koncepcióját hirdette, amelynek célja, hogy a modellek viselkedése biztonságos és az emberi értékekkel összhangban lévő legyen. Ez tökéletesen illeszkedik a vállalati igényekhez, ahol a kiszámíthatóság és a megbízhatóság kulcsfontosságú.

- Egyedi Alkalmazások Fejlesztése: A ServiceNow platform lehetővé teszi a vállalatok számára, hogy saját, egyedi AI-alapú alkalmazásokat fejlesszenek. A Claude modellek integrálásával ezek az alkalmazások képesek lesznek a vállalat saját adatait (a ServiceNow-ban tárolt tudást) felhasználni, ami lényegében egy beépített RAG képességet jelent.

- Gyorsabb Értékteremtés: Ahelyett, hogy a vállalatoknak nulláról kellene felépíteniük egy komplex AI infrastruktúrát, a ServiceNow-Anthropic partnerség egy kulcsrakész megoldást kínál. Ez jelentősen lerövidíti a fejlesztési időt és felgyorsítja a befektetés megtérülését (ROI).

Ez a szövetség egyértelműen validálja azt a piaci igényt, hogy a generatív AI-t biztonságosan és hatékonyan kell összekapcsolni a vállalati adatokkal. A RAG nem csupán egy elméleti koncepció többé, hanem egy olyan bevált gyakorlat, amelyet a piac legnagyobb szereplői is alkalmaznak a valódi üzleti értékteremtés érdekében.

Technikai Mélyfúrás: Hogyan Működik egy RAG AI Chatbot?

Ahhoz, hogy megértsük a RAG rendszerek erejét, érdemes mélyebbre ásni a motorháztető alá. A folyamat több, egymásra épülő lépésből áll, amelyek együttesen biztosítják a pontos és kontextus-tudatos válaszokat. Bontsuk le a RAG architektúrát a legfontosabb komponenseire.

RAG Architektúra Lebontása

A RAG rendszer két fő fázisból áll: az Offline Indexelésből, ahol a tudásbázist előkészítjük a keresésre, és az Online Lekérdezésből, amikor a felhasználói kérdésre valós időben generálunk választ. Mindkét fázis kritikus a rendszer hatékonysága szempontjából.

Adatfeldolgozás és Indexelés (Chunking, Embedding)

Mielőtt a chatbot bármilyen kérdésre válaszolhatna, a tudásbázist elő kell készíteni. Ez egy offline folyamat, amely általában a következő lépéseket tartalmazza:

- Adatbetöltés (Data Ingestion): A rendszer betölti a különböző forrásokból származó dokumentumokat (PDF, DOCX, HTML, stb.). Ez a lépés gyakran magában foglal egy ETL (Extract, Transform, Load) folyamatot, ahol az adatokat megtisztítják és egységes formátumra hozzák.

- Darabolás (Chunking): A hosszú dokumentumokat kisebb, logikai egységekre, úgynevezett „chunkokra” bontják. Ez kulcsfontosságú, mert a keresés ezeken a kisebb szövegrészleteken fog történni. A darabolás mérete és stratégiája (pl. fix méret, bekezdésenkénti bontás) jelentősen befolyásolhatja a visszakeresés minőségét.

- Beágyazás (Embedding): Ez a folyamat legmágikusabb része. Minden egyes szövegdarabot egy speciális AI modell, egy úgynevezett embedding modell, numerikus reprezentációvá alakít. Ez a reprezentáció egy több száz vagy ezer dimenziós vektor, amely megragadja a szöveg szemantikai jelentését. A hasonló jelentésű szövegek vektorai a többdimenziós térben közel helyezkednek el egymáshoz.

Az így kapott vektorokat a hozzájuk tartozó eredeti szöveggel együtt egy speciális adatbázisban, a vektoradatbázisban tároljuk.

Vektoradatbázisok és a Lekérdezési Mechanizmus

Amikor egy felhasználó feltesz egy kérdést, a RAG rendszer online fázisa aktiválódik:

- Lekérdezés Beágyazása: A felhasználó kérdését ugyanazzal az embedding modellel alakítjuk át vektorrá, mint amit az indexelés során használtunk.

- Hasonlósági Keresés: A rendszer a kérdés vektorát összehasonlítja a vektoradatbázisban tárolt összes szövegdarab vektorával. A cél, hogy megtalálja azokat a vektorokat (és a hozzájuk tartozó szövegrészleteket), amelyek a legközelebb állnak a kérdés vektorához a többdimenziós térben. Ezt a folyamatot „szemantikai keresésnek” vagy „hasonlósági keresésnek” nevezik.

- Kontextus Összeállítása: A legrelevánsabbnak ítélt (pl. top 5) szövegdarabot a rendszer összegyűjti. Ez lesz a „kontextus”, amelyet az LLM a válaszgeneráláshoz fog használni.

Generálás a Kontextus Alapján (LLM Integration)

Ez a folyamat utolsó lépése:

- Prompt Építés: A rendszer egy speciális promptot (utasítást) állít össze az LLM számára. Ez a prompt tipikusan tartalmazza az eredeti felhasználói kérdést és a visszakeresett kontextust. Például:

"A következő kontextus alapján válaszold meg a felhasználó kérdését. Kontextus: [ide jönnek a visszakeresett szövegdarabok]. Kérdés: [ide jön a felhasználó kérdése]." - Válaszgenerálás: Az LLM feldolgozza a promptot, és a megadott kontextus alapján generál egy választ. Mivel az LLM-nek konkrét, releváns információk állnak rendelkezésére, a válasza pontos és megalapozott lesz.

Ez a komplex, de rendkívül hatékony folyamat teszi lehetővé, hogy a RAG chatbotok megbízhatóan működjenek valós üzleti környezetben. Az adatfeldolgozó AI-ügynökeink pont az ilyen komplex adat-előkészítési és feldolgozási folyamatok automatizálására specializálódtak.

RAG AI Chatbot Építése: Lépésről Lépésre Útmutató Vállalatoknak

Egy vállalati szintű RAG AI chatbot implementálása egy jól strukturált projekt, amely gondos tervezést és szakértelmet igényel. Bár a technológia összetett, a folyamat logikus lépésekre bontható. Az alábbi útmutató felvázolja a legfontosabb szakaszokat, amelyekkel egy vállalatnak szembe kell néznie.

1. Használati Esetek Meghatározása és Adatforrások Azonosítása

Minden sikeres projekt a „miért”-tel kezdődik. Mielőtt egyetlen sor kódot is írnánk, tisztázni kell a célokat:

- Probléma Definíció: Milyen konkrét üzleti problémát szeretnénk megoldani? (Pl. a HR osztály leterheltségének csökkentése, az ügyfélszolgálati válaszidő javítása, a műszaki dokumentációban való keresés felgyorsítása.)

- Célközönség: Kik fogják használni a chatbotot? (Alkalmazottak, ügyfelek, fejlesztők?)

- Sikerkritériumok: Hogyan fogjuk mérni a projekt sikerét? (Pl. 20%-kal kevesebb HR-ticket, 30%-kal gyorsabb ügyfélkiszolgálás, stb.)

Ezután azonosítani kell a releváns tudásforrásokat. Hol található az az információ, amire a chatbotnak szüksége lesz? Ezek lehetnek:

- Strukturálatlan adatok: PDF-ek, Word dokumentumok, prezentációk, Confluence, SharePoint.

- Strukturált adatok: SQL adatbázisok, CRM rendszerek (pl. Salesforce), ERP rendszerek (pl. SAP).

- Fél-strukturált adatok: JSON, CSV fájlok, API végpontok.

2. Technológiai Stack Kiválasztása (LLM, Vektor DB, Framework)

A megfelelő technológiai komponensek kiválasztása kulcsfontosságú a rendszer teljesítménye és skálázhatósága szempontjából.

- Nagy Nyelvi Modell (LLM): A választás függ a feladattól, a költségvetéstől és a biztonsági követelményektől. Lehetőségek: Anthropic Claude (biztonság-fókuszú), OpenAI GPT-sorozat (csúcsteljesítmény), vagy akár nyílt forráskódú modellek (pl. Llama, Mistral) a teljes kontroll érdekében.

- Vektoradatbázis: Ez a komponens tárolja a dokumentumok numerikus reprezentációit. Népszerű opciók a Pinecone, Weaviate, ChromaDB vagy a felhőszolgáltatók saját megoldásai (pl. a PostgreSQL pgvector kiterjesztése).

- Framework: A fejlesztés felgyorsítására olyan keretrendszereket használhatunk, mint a LangChain vagy a LlamaIndex. Ezek előre megírt komponenseket kínálnak az adatbetöltéshez, daraboláshoz és a RAG láncok összeállításához.

3. Fejlesztés, Tesztelés és Finomhangolás

Ez a szakasz a tényleges implementációról szól:

- Adatfeldolgozási Pipeline Felépítése: Létre kell hozni azt az automatizált folyamatot, amely betölti, megtisztítja, darabolja és beágyazza az adatokat a vektoradatbázisba.

- RAG Lánc Implementálása: A kiválasztott framework segítségével össze kell kapcsolni a komponenseket: a felhasználói kérdés fogadása, a visszakeresés, a prompt építés és az LLM-hívás.

- Tesztelés és Értékelés: A rendszer teljesítményét objektív metrikákkal kell mérni. Olyan keretrendszerek, mint a RAGAs, segítenek értékelni a visszakeresés pontosságát (precision) és a generált válaszok minőségét (faithfulness).

- Finomhangolás: A teszteredmények alapján finomítani kell a rendszert. Ez jelentheti a darabolási stratégia módosítását, egy másik embedding modell kipróbálását, vagy a visszakeresési algoritmus paramétereinek állítását.

4. Telepítés és Folyamatos Karbantartás

Az élesítés után a munka nem ér véget.

- Telepítés (Deployment): A rendszert egy skálázható és biztonságos infrastruktúrára kell telepíteni, legyen az on-premise vagy felhőalapú. Biztosítani kell a megfelelő jogosultságkezelést és a felhasználói felületet (pl. egy webes chat interfész).

- Monitorozás és Naplózás: Folyamatosan figyelni kell a rendszer teljesítményét, a válaszidőket és az esetleges hibákat. A felhasználói interakciók naplózása segít azonosítani a gyenge pontokat.

- Folyamatos Fejlesztés: A tudásbázist rendszeresen frissíteni kell az új dokumentumokkal. A felhasználói visszajelzések alapján pedig tovább lehet finomítani a chatbot viselkedését és tudását.

Egy ilyen projekt komplexitása miatt sok vállalat választja a külső szakértői segítséget. Az AiSolve-nál egyedi automatizálási megoldásokat kínálunk, amelyekkel kulcsrakész, vállalati igényekre szabott RAG rendszereket építünk.

Kulcsfontosságú Szempontok a RAG Implementációhoz Vállalati Környezetben

Egy prototípus és egy vállalati szintű, éles környezetben működő RAG rendszer között hatalmas a különbség. Az utóbbi esetében számos olyan tényezőt kell figyelembe venni, amelyek a megbízhatóságot, biztonságot és skálázhatóságot garantálják.

- Biztonság: Ez a legfontosabb szempont. Meg kell oldani a felhasználói authentikációt és autorizációt, hogy mindenki csak azokhoz az információkhoz férjen hozzá, amelyekhez jogosultsága van. Az adatokat mind tárolás (at rest), mind átvitel (in transit) során titkosítani kell.

- Skálázhatóság: A rendszernek képesnek kell lennie kezelni a növekvő felhasználói terhelést és az adatmennyiség bővülését. Ez magában foglalja a vektoradatbázis, az LLM végpontok és a feldolgozó szolgáltatások horizontális skálázását.

- Adatkezelés (Data Governance): Pontosan meg kell határozni, mely adatforrások kerülnek be a tudásbázisba, és milyen gyakran frissülnek. Egyértelmű folyamatokat kell kialakítani az elavult vagy érzékeny információk eltávolítására.

- Költségoptimalizálás: Az LLM API hívások és a felhő infrastruktúra költséges lehet. Optimalizálni kell a folyamatokat, például gyorsítótárazással (caching) a gyakori kérdésekre, vagy a megfelelő méretű és teljesítményű modellek kiválasztásával.

- Válaszidő (Latency): A felhasználói élmény szempontjából kritikus, hogy a chatbot gyorsan válaszoljon. A rendszer minden komponensét (visszakeresés, LLM hívás) optimalizálni kell a sebességre, anélkül, hogy a minőség rovására menne.

- Integráció Meglévő Rendszerekkel: Egy vállalati chatbot ritkán működik elszigetelten. Integrálni kell a meglévő rendszerekkel, mint a CRM, ERP, vagy a belső authentikációs megoldások (pl. Active Directory).

Ezeknek a szempontoknak a figyelmen kívül hagyása egy olyan rendszerhez vezethet, amely technikailag működik, de üzletileg megbízhatatlan, drága és nehezen karbantartható. A sikeres vállalati implementációhoz holisztikus, mérnöki szemléletre van szükség.

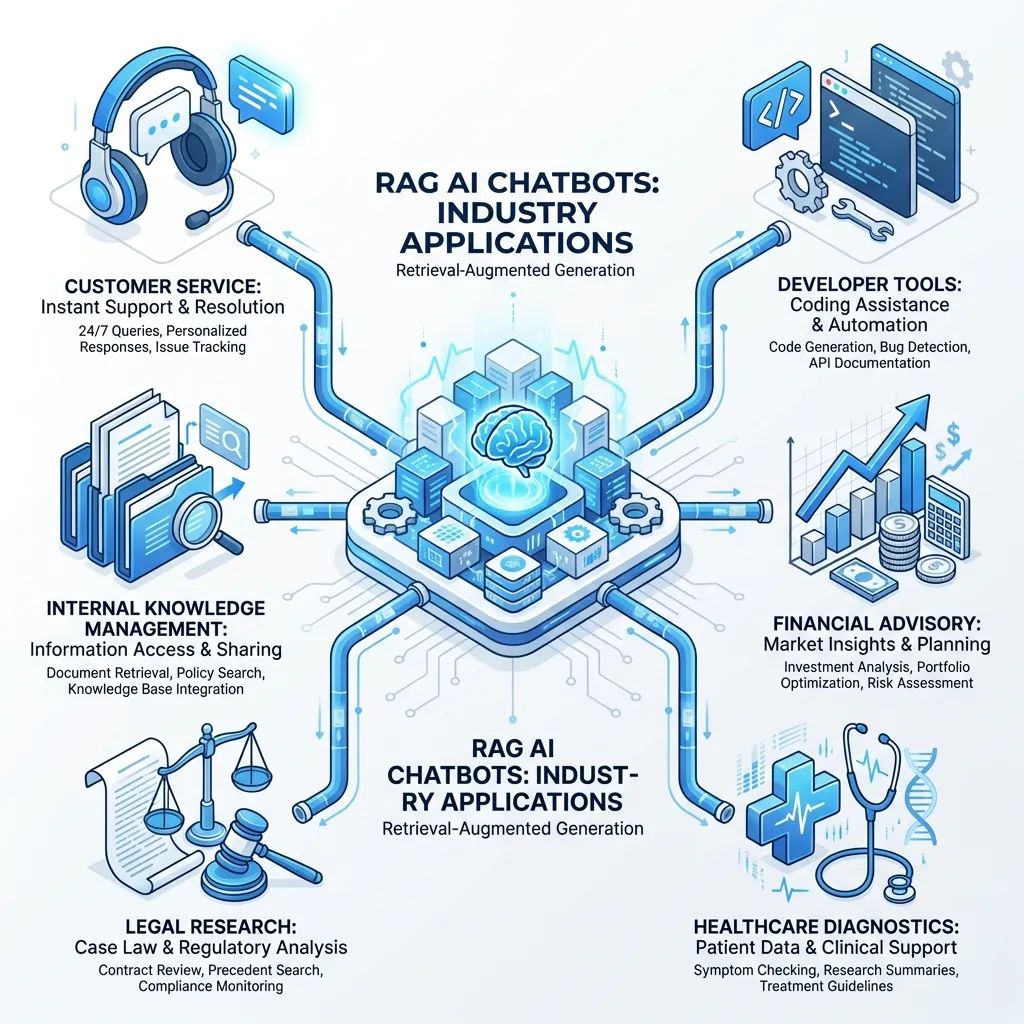

RAG AI Chatbotok Használati Esetei és Iparági Alkalmazásai

A RAG technológia sokoldalúsága lehetővé teszi, hogy szinte bármely iparágban és üzleti funkcióban értéket teremtsen, ahol a pontos és naprakész információhoz való gyors hozzáférés kulcsfontosságú. Az alábbiakban bemutatunk néhány konkrét példát.

- Intelligens Ügyfélszolgálat: A chatbotok azonnal válaszolhatnak az ügyfelek kérdéseire a termékdokumentáció, a GYIK és a korábbi support tickettek alapján. Képesek kezelni a komplex, többlépcsős problémákat is, és csak akkor eszkalálnak emberi operátorhoz, ha feltétlenül szükséges. Ez csökkenti a várakozási időt és növeli az ügyfélelégedettséget.

- Belső Tudásmenedzsment és HR Támogatás: Az alkalmazottak egy egyszerű chat felületen keresztül tehetik fel kérdéseiket a belső szabályzatokkal, HR irányelvekkel, IT problémákkal vagy a céges folyamatokkal kapcsolatban. Ahelyett, hogy órákig keresgélnének a Confluence-en vagy a SharePointon, másodpercek alatt pontos választ kapnak.

- Jogi és Megfelelőségi Kutatás: Az ügyvédi irodák és jogi osztályok hatalmas mennyiségű jogi dokumentumot, szerződést és esettanulmányt elemezhetnek a RAG segítségével. A rendszer segít megtalálni a releváns precedenseket és ellenőrizni a szerződések megfelelőségét a hatályos jogszabályoknak.

- Egészségügyi Döntéstámogatás: Az orvosok és kutatók a legfrissebb orvosi tanulmányok, klinikai vizsgálatok és páciensadatok alapján kaphatnak támogatást a diagnózis felállításához vagy a kezelési terv kidolgozásához. A rendszer segít szintetizálni a hatalmas mennyiségű orvosi tudást.

- Pénzügyi Tanácsadás és Elemzés: A pénzügyi tanácsadók a piaci jelentések, vállalati hírek és gazdasági előrejelzések alapján készíthetnek elemzéseket és adhatnak befektetési tanácsokat. A chatbot segít azonosítani a trendeket és a kockázatokat.

- Fejlesztői Eszközök és Műszaki Támogatás: A szoftverfejlesztők a technikai dokumentációban, API leírásokban és belső kódbázisban kereshetnek segítségért. A RAG chatbot segít a hibakeresésben, példakódokat ad, és megválaszolja a komplex architekturális kérdéseket.

A RAG Chatbotok Költséghatékonysága és ROI-ja

Egy RAG AI chatbot bevezetése jelentős kezdeti befektetést igényelhet, de a hosszú távú megtérülés (ROI) messze felülmúlhatja a költségeket. A gazdasági előnyök több területen is megmutatkoznak, és a legtöbb esetben számszerűsíthetők.

Közvetlen Költségcsökkentés:

- Operatív Hatékonyság: Az ismétlődő, manuális feladatok automatizálása felszabadítja az emberi munkaerőt. Például egy ügyfélszolgálati chatbot által kezelt ticket költsége töredéke egy emberi operátor által kezeltének.

- Csökkentett Képzési Idő: Az új munkatársak gyorsabban betanulhatnak, ha egy intelligens asszisztens áll rendelkezésükre, amely azonnal megválaszolja a kérdéseiket a belső folyamatokról.

Közvetett Előnyök és Bevételnövekedés:

- Javuló Döntéshozatal: Ha a vezetők és az alkalmazottak gyorsabban jutnak hozzá a pontos, adatokon alapuló információkhoz, jobb és gyorsabb döntéseket hozhatnak, ami piaci előnyhöz juttatja a céget.

- Növekvő Munkavállalói Elégedettség: A frusztráló, időigényes információkeresés helyett az alkalmazottak az értékteremtő munkára fókuszálhatnak, ami növeli a produktivitást és a munkahelyi elégedettséget.

- Fokozott Ügyfélhűség: A gyors, 24/7 elérhető és pontos ügyfélszolgálat javítja az ügyfélélményt, ami hosszú távon növeli a vásárlói hűséget és csökkenti az elvándorlást (churn).

Hipotetikus ROI Számítás:

Tegyük fel, egy közepes méretű vállalat ügyfélszolgálata havi 5000 ticketet kezel. Egy emberi operátor által kezelt ticket átlagköltsége 1500 Ft. Egy RAG chatbot bevezetése után a tickettek 60%-át (3000 ticket) az AI kezeli, 150 Ft-os átlagköltséggel.

- Költség RAG előtt: 5000 ticket * 1500 Ft/ticket = 7 500 000 Ft/hó

- Költség RAG után: (2000 ticket * 1500 Ft) + (3000 ticket * 150 Ft) = 3 000 000 Ft + 450 000 Ft = 3 450 000 Ft/hó

- Havi megtakarítás: 4 050 000 Ft

- Éves megtakarítás: 48 600 000 Ft

Ez a példa jól mutatja, hogy még egyetlen területen is milyen jelentős pénzügyi előnyökkel járhat a RAG technológia bevezetése, a nehezebben mérhető, de legalább ennyire fontos stratégiai előnyök mellett.

A RAG és az Enterprise AI Jövője: Trendek és Innovációk

A RAG technológia folyamatosan fejlődik, és a jövőben még kifinomultabb és hatékonyabb megoldásokra számíthatunk. Néhány izgalmas trend, amely már most formálja a vállalati AI jövőjét:

- Multimodális RAG: A jövő RAG rendszerei nemcsak szövegeket, hanem képeket, diagramokat, hangfájlokat és videókat is képesek lesznek feldolgozni és visszakeresni. Képzeljük el, hogy egy chatbot egy műszaki rajz alapján képes megválaszolni egy alkatrészre vonatkozó kérdést.

- Önfejlesztő RAG Rendszerek: A fejlett rendszerek képesek lesznek tanulni a felhasználói interakciókból. Ha egy válasz rossz volt, vagy a felhasználónak pontosítania kellett a kérdését, a rendszer ezt felhasználja a visszakeresési algoritmus finomítására.

- Proaktív és Ügynök-alapú RAG: A chatbotok nemcsak reaktívan válaszolnak majd a kérdésekre, hanem proaktívan is cselekedhetnek. Egy RAG-alapú AI ügynök képes lehet nemcsak megmondani, hogyan kell egy szabadságot igényelni, hanem a felhasználó kérésére el is indíthatja a folyamatot a HR rendszerben. Erről a témáról részletesebben is írtunk a Salesforce Slackbotról szóló cikkünkben.

- Mélyebb Integráció az Adatfolyamokkal: A RAG rendszerek egyre szorosabban integrálódnak a valós idejű adatfolyamokkal (streaming data), például IoT szenzorok adataival vagy pénzügyi piaci adatokkal, lehetővé téve az azonnali, naprakész elemzéseket.

Ezek az innovációk tovább fogják növelni a RAG rendszerek értékét, és még inkább a vállalati digitális transzformáció központi elemévé teszik őket.

Következtetés: A RAG AI Chatbotok, mint az Enterprise Digitális Transzformációjának Motorja

A Retrieval-Augmented Generation technológia áthidalja azt a kritikus szakadékot, amely eddig a nagy nyelvi modellek lenyűgöző potenciálja és a vállalati valóság szigorú követelményei között tátongott. A RAG nem csupán egy újabb AI-buzzword, hanem egy robusztus, gyakorlatias megoldás a pontosság, a biztonság és a relevancia problémájára.

Azzal, hogy az LLM-eket a vállalatok saját, ellenőrzött és naprakész tudásbázisaihoz kapcsolja, a RAG lehetővé teszi olyan intelligens asszisztensek létrehozását, amelyekben a cégek megbízhatnak. Ezek az eszközök csökkentik az operatív költségeket, felgyorsítják a döntéshozatalt, javítják az ügyfél- és munkavállalói élményt, és végső soron fenntartható versenyelőnyt biztosítanak.

A ServiceNow és az Anthropic partnerségéhez hasonló piaci fejlemények is azt mutatják, hogy az iparág a megbízható, vállalati szintű AI megoldások felé mozdul el. A kérdés már nem az, hogy egy vállalat bevezeti-e a RAG technológiát, hanem az, hogy mikor és hogyan.

Ha Ön is szeretné kihasználni a RAG AI chatbotokban rejlő lehetőségeket, és egy olyan megbízható, biztonságos és hatékony rendszert építene, amely valódi üzleti értéket teremt, vegye fel velünk a kapcsolatot. Ismerje meg személyre szabott RAG AI chatbot fejlesztési szolgáltatásainkat, és tegye meg az első lépést a vállalati intelligencia jövője felé.